Na TikToku pojawiły się liczne filmy z rasistowskimi treściami wygenerowane przez Google Veo 3. Zabezpieczenia AI nie zapobiegły tworzeniu nielegalnych materiałów.

Google ledwo co wypuściło Veo 3 na całym świecie, a już TikTok zalały filmy z rasistowskimi i antysemickimi treściami wygenerowane przez najnowszy model AI. Materiały realizowane są maksymalnie osiem sekund (ograniczenie Google’a) i są oznaczone wodnym znakiem Veo, co potwierdza ich pochodzenie. Filmy przedstawiają liczne stereotypy wymierzone w różne grupy społeczne.

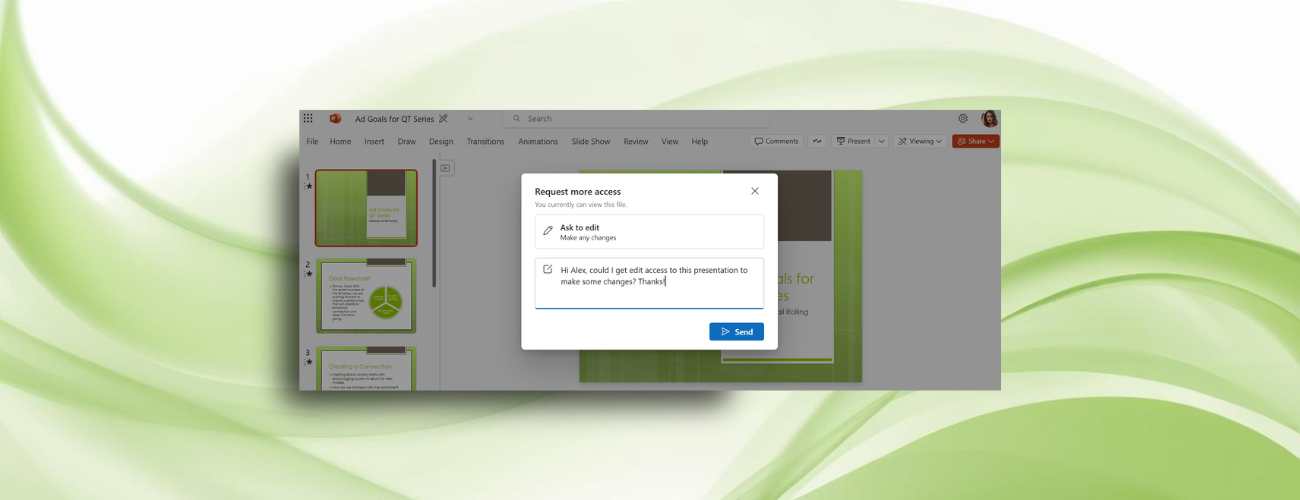

Google podczas prezentacji Veo 3 podkreślało znaczenie mechanizmów bezpieczeństwa, które miały blokować tworzenie treści naruszających zasady. Firma uchodzi za stosunkowo niezawodną w egzekwowaniu swoich wytycznych bezpieczeństwa. Jednak portal Ars Technica zdołał odtworzyć rasistowskie treści przy pomocy prostych poleceń, co wskazuje na nieprawidłowe działanie zabezpieczeń w najnowszej wersji generatora wideo.

TikTok również ponosi odpowiedzialność za rozprzestrzenianie się takich materiałów. Regulamin platformy jasno zabrania “mowy nienawiści, zachowań motywowanych nienawiścią lub promowania ideologii nienawiści”. Rzecznik TikToka wyjaśnił, iż platforma wykorzystuje zarówno ludzkich moderatorów, jak i technologie automatyczne do wykrywania zakazanych treści, jednak ogromna liczba codziennych publikacji utrudnia szybką moderację.

Więcej niż połowa kont TikToka wymienionych przez Media Matters została zablokowana jeszcze przed publikacją materiałów, a pozostałe zostały usunięte w międzyczasie. Eksperci wskazują, iż niejednoznaczność poleceń tekstowych i niezdolność AI do rozpoznawania rasistowskich stereotypów mogły umożliwić tworzenie takich filmów. Problem pogłębia fakt, iż w lutym 2025 roku Google osłabiło swoje zasady AI, usuwając zapis zakazujący wykorzystywania modeli do rozwoju broni.

6 godzin temu

6 godzin temu